作者:尤亦庄

编译:子 聿

量子力学是一个描写各种微观现象的理论。像其它物理理论一样,量子力学并不是这些实验现象的直接反映。人类引入了一些革命性的抽象概念,如波函数、态叠加等等。通过这些革命性的概念,加上线性代数的数学基础,人类构造了量子力学理论,而其正好能描写所有我们能看到的微观现象。这反映了人类的最高智慧。也许有人会问:人工智能中的神经网络是否能具有类似的智慧?

在最近的一个工作中,作者们展示了一个机器学习算法——通过学习冷原子的玻色爱因斯坦凝聚这一量子现象,来“发现”量子力学理论。我们知道冷原子所感受的势能函数形状和其玻色-爱因斯坦凝聚体密度是有一个关系的。这一工作让机器学习这一关系来“发现”量子力学中波函数的概念。

——文小刚

演生现象一直都是凝聚态物理学的核心议题。它指的是一个复杂的多体系统会在集体行为中涌现出全新的更高层次的规律和现象。不仅仅是物质和力可以是演生的,时空与引力也可以是演生的。人们正在物理学的前沿研究中积极地探索这些令人激动的想法。等一下,那这些物理学理论本身是否也是演生现象呢?这倒是一个很有趣的想法。物理学理论的确是来源于人脑中神经元的集体活动。但是我们还不清楚物理学的想法是如何从一个物理学家的神经网络中演生出来的,或者更广泛地说,是如何在物理学共同体的社会网络中涌现出来的。理解复杂网络中演生智慧的普适原理应该是当代科学的重要目标。

我们或许还远远不能深刻理解“智慧”本身。但是,最近机器学习研究的发展可以让我们朝这方向迈开第一步。我们希望探索是否可以利用人工神经网络来通过实验数据发现物理学概念和规律。让我们以量子力学为例。假设目前量子力学还没有被创立,但神奇的是,物理学家们知道如何构建冷原子实验来收集不同形状势阱中玻色-爱因斯坦凝聚体的密度分布。那么,在不受人类文明的影响下,机器是否能重新发现量子力学其实是能够解释实验数据的最自然的理论?抑或是机器可以提出另外一种形式的量子力学?

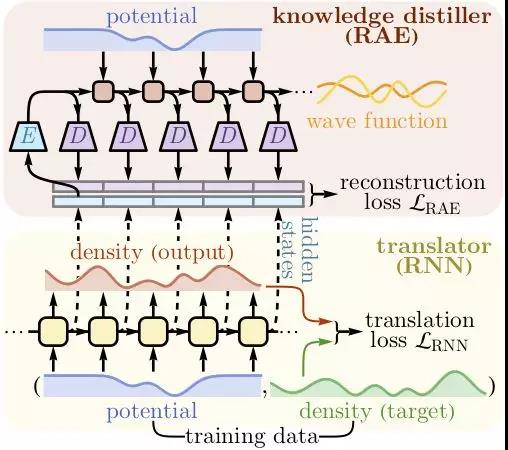

在我们最近的一个工作中(arXiv:1901.11103,点击阅读原文可获取全文),我们展示了一个机器学习算法如何通过学习基于势的形状预测玻色-爱因斯坦凝聚体密度的任务来“发现”量子力学。只需要将势和密度作为数据来训练机器,量子波函数就可以作为隐变量在神经网络中浮现出来。我们受到了机器翻译研究进展的启发:人们训练机器来把词语序列从一种语言翻译到另外一种。机器翻译器就能够在它的隐藏层中发展一个语义空间,来容纳单词或者词组对所有语言普适的内在表示。通过分析语义空间的结构,我们可以得到翻译器所“感知”到的词语之间的关系。以此推之,我们把势-密度的映射关系当做一种序列-序列映射来处理,而这恰恰是机器翻译方法——例如递归神经网络所擅长处理的。

我们训练递归神经网络把一维势阱形态“翻译”成对应的密度分布。通过学习如何更好地完成这个翻译任务,机器会获得关于其背后物理规律的一些直觉。为了提炼机器翻译器究竟认识到了什么,我们设计了一个更高级别的机器,称之为知识提炼器,它以较低级别的翻译器神经网络的隐态为其学习对象。知识提炼器是嵌套在另外一个递归神经网络中的自编码器。它的任务就是尽可能地压缩翻译器在每步中生成的隐态,但是又不丢失重建后续隐态的预测能力。按照这种方式,知识提炼器能够识别关键变量。我们的研究表明只有在其隐态空间维度低于二维的时候,知识提炼器的重构损失才会突然增加。这说明至少需要有两个实变量来刻画势-密度翻译器的行为。当我们把这两个变量画出,就会发现他们其实对应着量子波函数的实部与虚部。进一步的检查发现这些变量的更新规律由一个递归关系所描述,而这个递归关系则精准地吻合了薛定谔方程的离散形式。量子力学的知识的的确确在神经网络中演生出来了。

更有意思的是,如果我们放松知识提炼器的信息瓶颈,那么量子力学的其他形式,例如密度泛函理论,也可以被发展出来。但是这些替代理论需要至少三个实数变量来描述。令人欣慰的是,人类现在基于波函数和薛定谔方程来刻画的量子力学,的确是在我们的神经网络所发现的全部量子力学等价理论中最简洁的一个理论。

尤亦庄,上述工作(arXiv:1901.11103)的通讯作者。

2013年于清华大学高等研究中心取得博士学位,后赴加州大学圣巴巴拉分校及哈佛大学从事博士后研究。2018年任教于加州大学圣地亚哥分校,现为物理系助理教授。主要研究方向是凝聚态系统中的拓扑物相、量子纠缠和机器学习等问题。

原文链接:http://suo.im/4qsqod

版权声明:本文由科技工作者之家—科界App子栏目《返朴》原创,投稿/授权/合作,请联系 fanpu2019@outlook.com